“ AI Marathon”有一个很棒的文学模式

作者:bet356在线官方网站 发布时间:2025-05-23 15:41

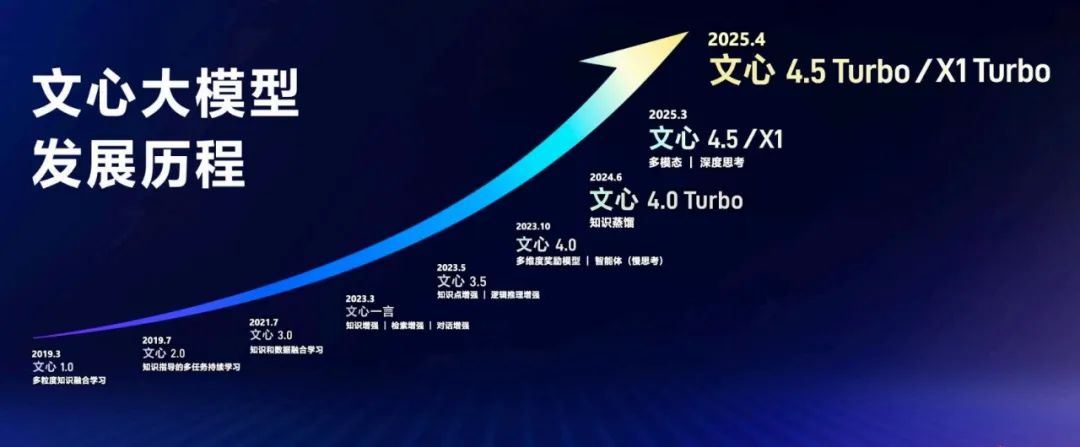

机器的原始核心:张卡安(Zhang Qian)为百度(Baidu),我们必须维持长期战略决策,并灵活地适应技术路线。在这一一轮科学和技术革命中,“变化和变化”的这种平衡可能是其获胜策略。在2025年,该模型特征的重要性尚无必要。从培训之前的角度来看,即使是OpenAI的前任科学家Ilya Sutskever也表示,培训前数据正在累,但是提取了许多多模式数据资源,例如图像和视频。从训练后的角度来看,新的强化学习范式为规模方法提供了新的生活,而新一代推理模型继续在数学,代码和延长距离计划等问题上的新进展。 AI公司在基本模型的研究和开发方面仍然非常必要。在这个阶段,这仍然是爬高峰的本质智力。在这个领域,百度一直是不容忽视的力量。从Wenxin Big Model 1.0的发布到2019年的今天,Wenxin Big模型从学习到知识和数据的融合,再到加强搜索,增强对话,增强对话,增强逻辑推理,缓慢的思维以及多模态技术的演变,不是一致的思考,而不是促进了“促进”的知识的结果,从而促进了“跨性别”,从而实现了“跨性别”,“越来越多”,“跨越了”,从而实现了跨越的竞争,即跨越的竞争,即逐渐成熟,即跨越的现实,即逐渐界定的兴趣,并不是在促进竞争的发展。加强知识点。正是这种“积累”引导了百度,创建了Wenxin 4.5 Turbo,这是超过GPT-4O的大型多模式模型,以及Wenxin X1 Turbo,这是导致DepSeek R1和V3的深思熟虑模型。这些技术发展反映了百度在基本研究和进步中的可持续性,该研究和进步及时地寻求“变革”,并迅速迭代AI。两天前,在百度AI的那天,百度集团副总裁Wu Tian对最新的Wenxin模型的创新技术进行了更深入的解释,以解决许多行业对Baidu Wenxin伟大模型的关注。通过其交流,我们瞥见了百度在基本模型的研发领域遵守的技术演变的基本概念和路径。你可以这样做。它还对评估数据背后的Paleta Paleta Palette的生态学有了更清晰的了解。吴蒂安(Wu Tian)在人工智能日地点攻击温辛(Wen Xin),证明了解决温辛(Wen Xin)涡轮X1问题的案例。这个问题不仅包括文本解释,还包括几何图,其中模型需要通过Wen Xin X1Turbo的答案来整合多模式信息,以判断Infere,他有一个非常清晰的想法,可以考虑回答这个问题。您可以独立计划,确定清晰的信息和摄影的隐藏含义,思考和分析PRE对每种选项的响应结束,最后提供了全面的解决方案和响应。这也通过一些授权参考点进行了验证。 Wenxin X1 Turbo领先于DeepSeek R1和V3的最新版本,略低于Openai O1完整Vood版本。此外,对中国信息学院通信技术模型的推理能力的重要评估还表明,WEN XIN XIN X1 Turbo在24个测试16技能奖项中工作得令人难以置信。 5分,七个要素得分4分,一个元素得分3分,积分等级达到了“ 4+”,这使其成为Chinain中的第一个出色模型。评估的结果表明,该模型已经获得了完整的技术能力品牌,例如逻辑推理,代码推理,推理效果的优化,工具支持,安全性,可靠性等。这样的第三方资格意味着涡轮Wenxin X1是牢固的在国内推理模型的第一个层次结构中。除了推理能力之外,为什么涡轮Wenxin X1和先前的Wenxin X1与成本优势密切相关。具有可比的功能,Wenxin X1已达到DeepSeek R1的一半。 X1 Turbo走得更远,DeepSeek-R1的价格为25%,这使一些嫉妒的国际开发商。用吴田的话来说,无论是多模式还是深思熟虑,都是“胜利”。从对多模型模型的深刻语义理解到大型多模式规模,百度是最早进行多模式研究的AI公司之一。他们在2018年的2018年取得了进步,“具有深刻的语义理解中的多模式”。语义和语义理解。 “这,他们的技术路线已经发生了很大的发展,进入了一个大型多模式的时代。编码空间和时间搬迁:最大程度地使用时间信息和时间序列的机智H视频数据。多种方式和多模式之间的相互益处是大型模型的发展趋势。在学习加强基础设施的方向方面的一些进步,例如PARL RENFORICTION学习框架,并促进了Profundo今天的研究和发展。确定的问题与今天不同,以前的模型主要着重于解决单个任务,今天的模型正在解决大量常见任务。为了应对新的挑战,百度已经实施了许多创新,其中包括:自治改进技术框架:建立“改进培训生成”的闭路电路,使模型可以根据自己的一代和评估反馈能力继续重复。学习加强以整合优先学习:将最喜欢的用户学习结合在一起,将高质量结果与增强学习结合在一起,以提高对数据使用效率的看法模型。多维和统一的奖励机制:多个评估标准的整合(作为结果的精度,执行反馈,思想的profundidad,遵守指导的依从性),以确定模型的性能并帮助模型开发更好。整合思想和行为的复杂思想链:通过强化学习,模型可以探索适当的思想链,并为不同任务的行动链组合,从而提高了其长期解决实际复杂任务的能力。这些解决方案的出现也是技术发展的自然结果。吴蒂解释说,当前的基本模型具有强大的概括能力。换句话说,模型可以探索多任务处理,并提供有关模型产生结果的反馈,并且模型中自我偏离的方向继续通过增强学习技术发展。这是提高的重要方法OVE模型的有效性。随着复杂的数据构建模型在多模式和详细的推断中的发展,数据构建的难度也会增加。吴田说,构建多模式数据本身比构建简单的文本数据更加困难,更复杂。此外,当前基于许多多模式任务的条目是处理或中间的。例如,该模型必须通过通知生成。目前用来绘制文本和传记模型的指示获得了出色的总体图像效果,而不是日常生活中使用的自然文本表示方法。就是这样。在许多情况下,您必须添加设计术语,例如“纸质纹理”,“ tyndal效果”和照片的百分比。因此,必须使用几种技术方法对其进行探索和合成。另一个挑战是构建稀有数据。自然数据的分布与我们想要的那样,自然数据的分布与置于螺旋的系统不一致。在这个点,必须提取一些罕见数据。在解决这些问题的过程中,多年来对百度的知识图进行了研究,帮助他们建立了一个完整的知识系统,为罕见数据提取提供了理论支持和实践指导。此外,它创建了一个闭合电路,用于构建“数据挖掘和合成 - 数据分析和评估 - 模型容量反馈”的数据,该数据连续地生成了高知识密度,各种类型和广阔的模型培训领域。所有的“桨桨”,“ Wenkisin”一个“调色板调色板的脚本”不能与调色板的调整和优化相距。这也是百度和其他AI公司之间的一个截然不同的观点。作为中国的第一个深度学习平台底源,桨桨已经发展起来,自2018年以来已经发展,并在Paddle Paddle Framework版本3.0中重复。 。百度AI的技术架构扮演钥匙使用模型层来解决多模式集成和MOE的专家平衡等问题时的“腰部”角色,并与计算机能量层合作,以提高并行训练和推理性能的效率,实现成本降低和提高大型模型的效率。此外,吴田还说,调色板和温kisin的持续进展与百度对连续生态系统的贡献密不可分。通过多年的积累,百度在全国许多地方实施了工业授权中心,数据生态中心和教育创新中心。信任桨桨的深度学习平台以及在Modelwenxin Big中,我们将数千个行业与广泛的相关系统相结合,以使自己满足更多样化的行业的需求,增强了本地智能的本地工业更新。更重要的是,该生态系统形成了D的闭路机制ATA反馈。这些罕见的数据在各种行业中都无法通过纯技术手段获得,并且可以通过深层的生态合作逐渐提取和整合,从而为Wenxin Big模型的连续发展提供了稳定的养分流动。长期轨道选择:回顾2025年马拉松时间节点,百度在AI领域的设计反映了明显的长期特征。从Kunlun芯片到划船标记,大型模型和上层应用程序,Baidu遵循“完整的堆,研发和开发设计独立的技术途径。”将来,BAIDU中的两个技术说明是首选。多模式和聪明的身体。该机构是基于基本模型的AI的复杂系统。它们从简单的理解和生成工具更新到一种行动系统,使他们能够对S进行思考长期步骤,计划并独立致电。将来。该行业中的行业中的许多问题都可以完美地看到其应用程序,并创建一个活跃的大型模型应用程序生态系统。在此阶段,整个IA生态系统仍在经历深刻的变化,而技术影响则随着波浪而扩展。在这一轮技术革命中,百度·韦克森(Baidu Wenxin)的“变化与解散”可能是一项胜利策略。

机器的原始核心:张卡安(Zhang Qian)为百度(Baidu),我们必须维持长期战略决策,并灵活地适应技术路线。在这一一轮科学和技术革命中,“变化和变化”的这种平衡可能是其获胜策略。在2025年,该模型特征的重要性尚无必要。从培训之前的角度来看,即使是OpenAI的前任科学家Ilya Sutskever也表示,培训前数据正在累,但是提取了许多多模式数据资源,例如图像和视频。从训练后的角度来看,新的强化学习范式为规模方法提供了新的生活,而新一代推理模型继续在数学,代码和延长距离计划等问题上的新进展。 AI公司在基本模型的研究和开发方面仍然非常必要。在这个阶段,这仍然是爬高峰的本质智力。在这个领域,百度一直是不容忽视的力量。从Wenxin Big Model 1.0的发布到2019年的今天,Wenxin Big模型从学习到知识和数据的融合,再到加强搜索,增强对话,增强对话,增强逻辑推理,缓慢的思维以及多模态技术的演变,不是一致的思考,而不是促进了“促进”的知识的结果,从而促进了“跨性别”,从而实现了“跨性别”,“越来越多”,“跨越了”,从而实现了跨越的竞争,即跨越的竞争,即逐渐成熟,即跨越的现实,即逐渐界定的兴趣,并不是在促进竞争的发展。加强知识点。正是这种“积累”引导了百度,创建了Wenxin 4.5 Turbo,这是超过GPT-4O的大型多模式模型,以及Wenxin X1 Turbo,这是导致DepSeek R1和V3的深思熟虑模型。这些技术发展反映了百度在基本研究和进步中的可持续性,该研究和进步及时地寻求“变革”,并迅速迭代AI。两天前,在百度AI的那天,百度集团副总裁Wu Tian对最新的Wenxin模型的创新技术进行了更深入的解释,以解决许多行业对Baidu Wenxin伟大模型的关注。通过其交流,我们瞥见了百度在基本模型的研发领域遵守的技术演变的基本概念和路径。你可以这样做。它还对评估数据背后的Paleta Paleta Palette的生态学有了更清晰的了解。吴蒂安(Wu Tian)在人工智能日地点攻击温辛(Wen Xin),证明了解决温辛(Wen Xin)涡轮X1问题的案例。这个问题不仅包括文本解释,还包括几何图,其中模型需要通过Wen Xin X1Turbo的答案来整合多模式信息,以判断Infere,他有一个非常清晰的想法,可以考虑回答这个问题。您可以独立计划,确定清晰的信息和摄影的隐藏含义,思考和分析PRE对每种选项的响应结束,最后提供了全面的解决方案和响应。这也通过一些授权参考点进行了验证。 Wenxin X1 Turbo领先于DeepSeek R1和V3的最新版本,略低于Openai O1完整Vood版本。此外,对中国信息学院通信技术模型的推理能力的重要评估还表明,WEN XIN XIN X1 Turbo在24个测试16技能奖项中工作得令人难以置信。 5分,七个要素得分4分,一个元素得分3分,积分等级达到了“ 4+”,这使其成为Chinain中的第一个出色模型。评估的结果表明,该模型已经获得了完整的技术能力品牌,例如逻辑推理,代码推理,推理效果的优化,工具支持,安全性,可靠性等。这样的第三方资格意味着涡轮Wenxin X1是牢固的在国内推理模型的第一个层次结构中。除了推理能力之外,为什么涡轮Wenxin X1和先前的Wenxin X1与成本优势密切相关。具有可比的功能,Wenxin X1已达到DeepSeek R1的一半。 X1 Turbo走得更远,DeepSeek-R1的价格为25%,这使一些嫉妒的国际开发商。用吴田的话来说,无论是多模式还是深思熟虑,都是“胜利”。从对多模型模型的深刻语义理解到大型多模式规模,百度是最早进行多模式研究的AI公司之一。他们在2018年的2018年取得了进步,“具有深刻的语义理解中的多模式”。语义和语义理解。 “这,他们的技术路线已经发生了很大的发展,进入了一个大型多模式的时代。编码空间和时间搬迁:最大程度地使用时间信息和时间序列的机智H视频数据。多种方式和多模式之间的相互益处是大型模型的发展趋势。在学习加强基础设施的方向方面的一些进步,例如PARL RENFORICTION学习框架,并促进了Profundo今天的研究和发展。确定的问题与今天不同,以前的模型主要着重于解决单个任务,今天的模型正在解决大量常见任务。为了应对新的挑战,百度已经实施了许多创新,其中包括:自治改进技术框架:建立“改进培训生成”的闭路电路,使模型可以根据自己的一代和评估反馈能力继续重复。学习加强以整合优先学习:将最喜欢的用户学习结合在一起,将高质量结果与增强学习结合在一起,以提高对数据使用效率的看法模型。多维和统一的奖励机制:多个评估标准的整合(作为结果的精度,执行反馈,思想的profundidad,遵守指导的依从性),以确定模型的性能并帮助模型开发更好。整合思想和行为的复杂思想链:通过强化学习,模型可以探索适当的思想链,并为不同任务的行动链组合,从而提高了其长期解决实际复杂任务的能力。这些解决方案的出现也是技术发展的自然结果。吴蒂解释说,当前的基本模型具有强大的概括能力。换句话说,模型可以探索多任务处理,并提供有关模型产生结果的反馈,并且模型中自我偏离的方向继续通过增强学习技术发展。这是提高的重要方法OVE模型的有效性。随着复杂的数据构建模型在多模式和详细的推断中的发展,数据构建的难度也会增加。吴田说,构建多模式数据本身比构建简单的文本数据更加困难,更复杂。此外,当前基于许多多模式任务的条目是处理或中间的。例如,该模型必须通过通知生成。目前用来绘制文本和传记模型的指示获得了出色的总体图像效果,而不是日常生活中使用的自然文本表示方法。就是这样。在许多情况下,您必须添加设计术语,例如“纸质纹理”,“ tyndal效果”和照片的百分比。因此,必须使用几种技术方法对其进行探索和合成。另一个挑战是构建稀有数据。自然数据的分布与我们想要的那样,自然数据的分布与置于螺旋的系统不一致。在这个点,必须提取一些罕见数据。在解决这些问题的过程中,多年来对百度的知识图进行了研究,帮助他们建立了一个完整的知识系统,为罕见数据提取提供了理论支持和实践指导。此外,它创建了一个闭合电路,用于构建“数据挖掘和合成 - 数据分析和评估 - 模型容量反馈”的数据,该数据连续地生成了高知识密度,各种类型和广阔的模型培训领域。所有的“桨桨”,“ Wenkisin”一个“调色板调色板的脚本”不能与调色板的调整和优化相距。这也是百度和其他AI公司之间的一个截然不同的观点。作为中国的第一个深度学习平台底源,桨桨已经发展起来,自2018年以来已经发展,并在Paddle Paddle Framework版本3.0中重复。 。百度AI的技术架构扮演钥匙使用模型层来解决多模式集成和MOE的专家平衡等问题时的“腰部”角色,并与计算机能量层合作,以提高并行训练和推理性能的效率,实现成本降低和提高大型模型的效率。此外,吴田还说,调色板和温kisin的持续进展与百度对连续生态系统的贡献密不可分。通过多年的积累,百度在全国许多地方实施了工业授权中心,数据生态中心和教育创新中心。信任桨桨的深度学习平台以及在Modelwenxin Big中,我们将数千个行业与广泛的相关系统相结合,以使自己满足更多样化的行业的需求,增强了本地智能的本地工业更新。更重要的是,该生态系统形成了D的闭路机制ATA反馈。这些罕见的数据在各种行业中都无法通过纯技术手段获得,并且可以通过深层的生态合作逐渐提取和整合,从而为Wenxin Big模型的连续发展提供了稳定的养分流动。长期轨道选择:回顾2025年马拉松时间节点,百度在AI领域的设计反映了明显的长期特征。从Kunlun芯片到划船标记,大型模型和上层应用程序,Baidu遵循“完整的堆,研发和开发设计独立的技术途径。”将来,BAIDU中的两个技术说明是首选。多模式和聪明的身体。该机构是基于基本模型的AI的复杂系统。它们从简单的理解和生成工具更新到一种行动系统,使他们能够对S进行思考长期步骤,计划并独立致电。将来。该行业中的行业中的许多问题都可以完美地看到其应用程序,并创建一个活跃的大型模型应用程序生态系统。在此阶段,整个IA生态系统仍在经历深刻的变化,而技术影响则随着波浪而扩展。在这一轮技术革命中,百度·韦克森(Baidu Wenxin)的“变化与解散”可能是一项胜利策略。